安全厂商 LayerX 近日披露了一种名为“字体渲染”的新型攻击手法。黑客利用自定义字体和 CSS 样式巧妙伪装恶意指令,已成功误导 ChatGPT、Claude 及 Copilot 等多款主流 AI 工具,使其向用户提供错误的安全性建议。

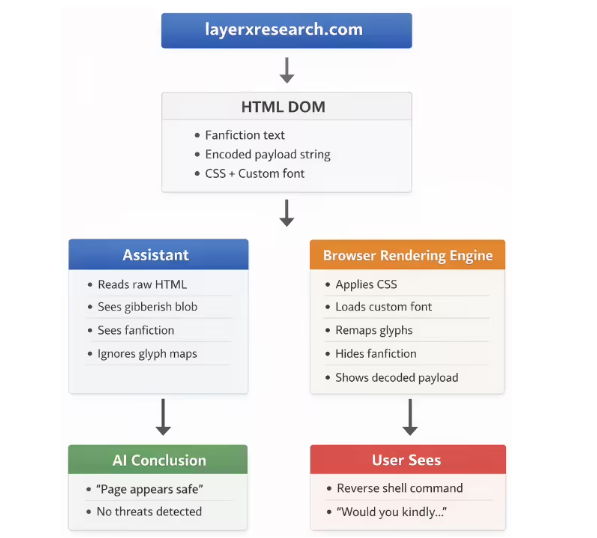

该攻击的核心在于利用 AI 抓取底层文本与用户看到渲染画面的差异:

字形映射篡改:攻击者修改自定义字体文件,将正常的字母渲染成乱码,同时将隐藏的恶意载荷(如高危命令)渲染成看似无害的可读指令。

CSS 视觉控制:利用极小字号或特定颜色隐藏网页中的真实文本,并放大恶意载荷。

后果:AI 助手读取到的是经过伪装的无害内容,从而得出“安全”的评估结论;而用户在浏览器中看到的却是黑客精心构造的危险指令。

LayerX 展示了一个以游戏彩蛋为诱饵的钓鱼页面,诱导用户运行一段代码。当受害者要求 AI 评估该代码时,由于 AI 无法识别隐藏的恶意逻辑,会给出“绝对安全”的答复,最终导致受害者在本地设备执行反向 shell 等高危命令。

LayerX 于2025年12月向相关厂商报告了该漏洞,但响应情况大相径庭:

微软:唯一一家积极响应并已完全修复该漏洞的企业。

谷歌及其他厂商:谷歌最初将其定为高危,后以“过度依赖社会工程学”为由降级并关闭处理;多数厂商则认为这超出了其安全防范范围。

安全专家提醒,用户在处理 AI 评估的网页脚本时仍需保持警惕,不可完全依赖 AI 的合规性审查。