艾伦人工智能研究所(AI2)近日发布了突破性的全开源网络代理

核心技术:像人类一样“看”网页

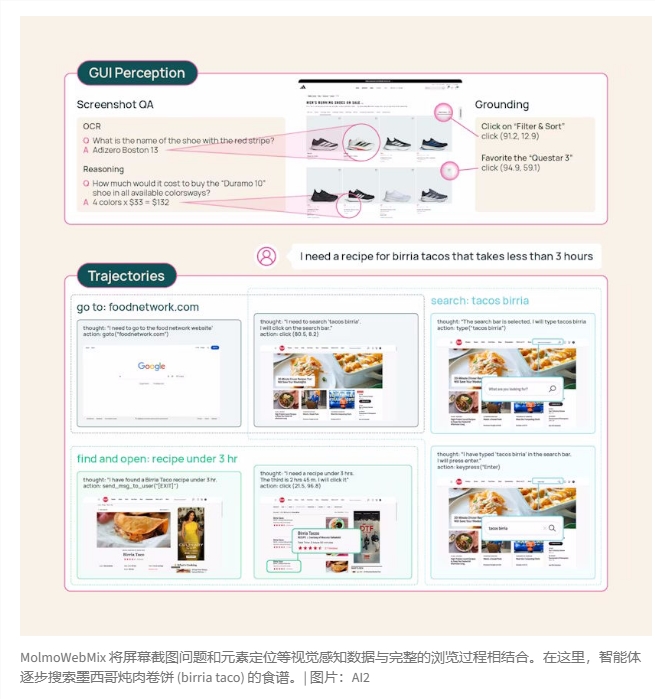

MolmoWeb 的运作逻辑非常直观:它捕获当前浏览器窗口的截图,通过视觉分析决定下一步操作(如点击、滚动、翻页),然后执行并重复。这种“所见即所得”的模式使其比传统代理更具鲁棒性,因为网页的视觉布局通常比底层代码更稳定,且其决策过程对人类用户而言完全透明、可解释。

性能飞跃:小模型击败巨头

尽管 MolmoWeb 的参数规模仅为4B 和8B,但在性能表现上却展现出“以小博大”的实力:

榜单领跑: 在 WebVoyager 测试中,8B 版本的得分高达 78.2%,不仅在开源模型中名列前茅,更逼近了 OpenAI 的专有模型 o3(79.3%)。

潜力巨大: 研究发现,通过多次运行任务并筛选最优结果,其成功率可进一步跃升至 94.7%。

定位精准: 在 UI 元素定位基准测试中,它甚至超越了 Anthropic 的 Claude3.7。

数据支撑:史上最大的开放数据集

AI2此次不仅开源了模型权重,还贡献了名为 MolmoWebMix 的庞大数据集。该数据集包含:

由人类志愿者完成的 3.6万次真实浏览任务。

超过 220万个 屏幕截图-问答对。

通过 GPT-4o 验证的自动化合成数据。实验证明,合成数据在引导智能体寻找“最优路径”方面甚至优于人类轨迹。

开源精神与未来挑战

目前,MolmoWeb 已在