4月9日,字节跳动 Seed 团队正式发布原生全双工语音大模型 Seeduplex,标志着 AI 语音交互从传统的“回合制”向更贴近人类直觉的“实时自然交互”演进。作为豆包端到端语音模型的重大升级,Seeduplex 核心突破在于实现了“边听边说”的同步处理框架,从底层架构上释放了语音交互的自然感。目前,该技术已在豆包 App 全量上线,完成了全双工技术从实验室向亿级用户规模化落地的跨越。

Seeduplex 通过语音与语义的联合建模,显著提升了模型在复杂声学环境下的抗干扰能力。相比半双工方案,其误回复率与误打断率降低了50%,即便在导航干扰、多人混叠或环境杂音中,也能精准识别主用户意图并联动环境信息。

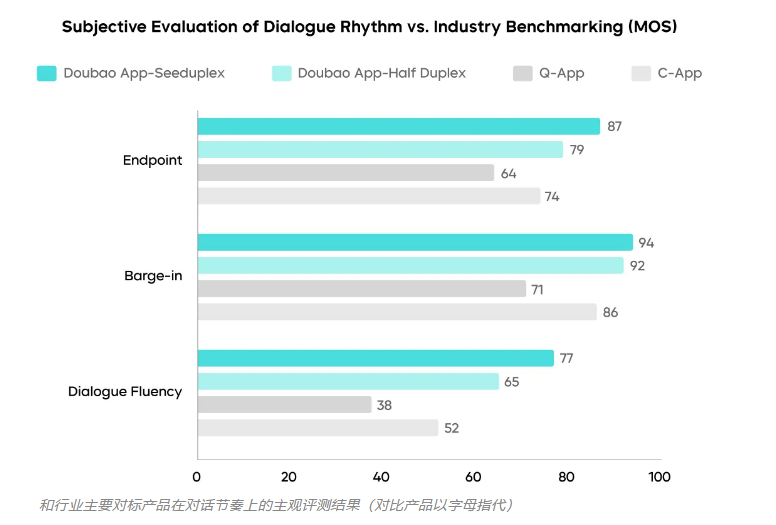

在对话节奏控制上,该模型引入动态判停技术,将判停延迟缩短约250ms,抢话比例下降40%,能敏锐区分用户的“思考留白”与“对话结束”。工程层面,团队通过投机采样与量化优化,在确保超低时延的同时解决了高并发下的卡顿挑战,使通话满意度绝对值提升8.34%。

Seeduplex 的落地不仅是交互效率的飞跃,更预示着感知、思考与执行一体化的未来趋势。随着后续视觉模态的引入,语音助手将向“听、看、想、说”多维协同的通用智能体深度进化,重塑智能硬件及多模态交互的行业标准。

项目主页:

https://seed.bytedance.com/seeduplex