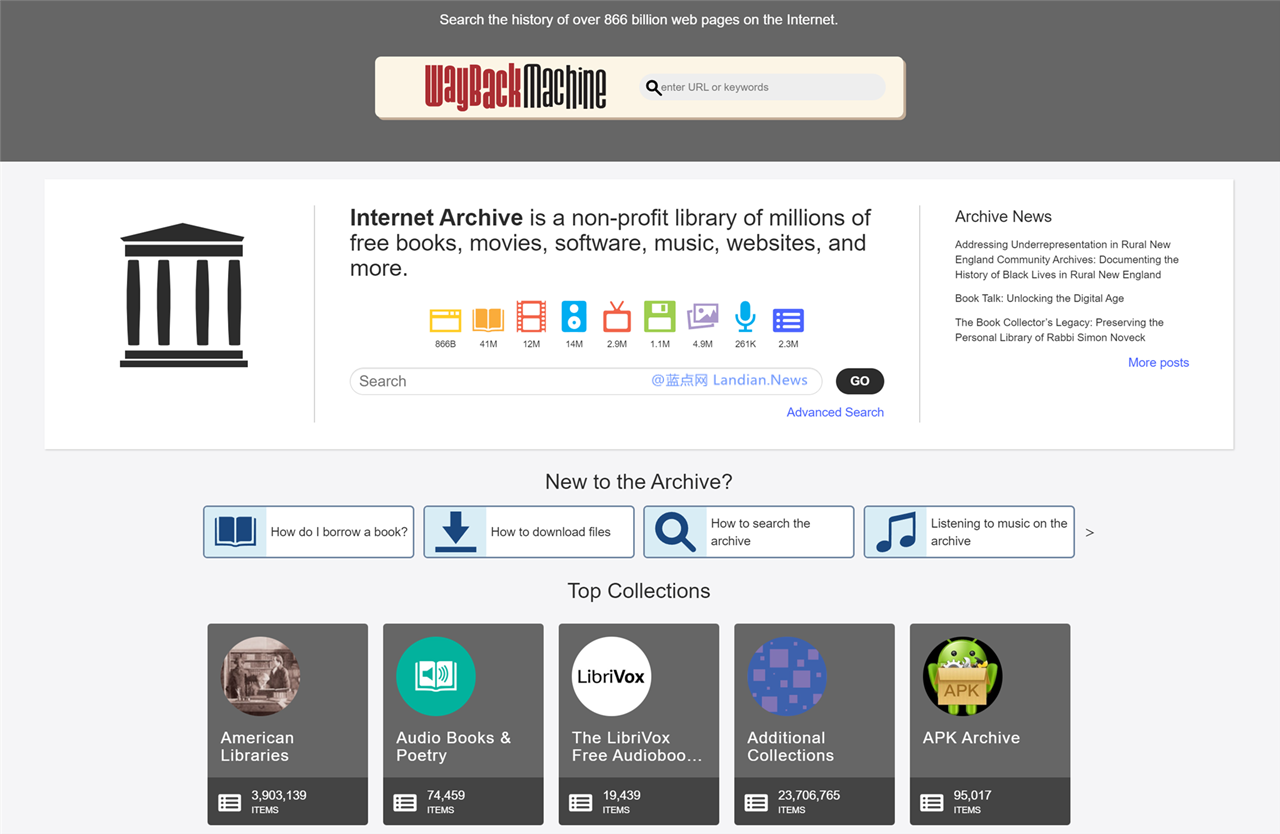

据 WIRED 发布的消息,目前在美国已经有诸多网站开始屏蔽互联网档案馆旗下的网站时光机 (Wayback Machine) 快照功能,即不再允许网站时光机抓取这些新闻网站的页面并将其存档,原因则是 AI 爬虫抓取数据拿来训练模型。

目前人工智能热潮已经让大量网站的流量出现大幅度下滑,而 AI 公司则是想方设法绕过限制非法抓取网站内容,最终将抓取到的数据用于 AI 对话机器人或者用于训练后续的人工智能模型。

对于网站来说这种行为存在未经许可的抓取和使用内容,以及会造成网站流量下滑,所以不少网站都已经在 robots.txt 里明确禁止来自人工智能的搜索爬虫抓取网站数据。

互联网档案馆和用户都被误杀:

基于保护自身合法权益和利益,包括今日美国、纽约时报等多家知名新闻媒体已经屏蔽互联网档案馆的网站时光机,这些新闻网站将 ia_archiverbot 爬虫排除在外,这是互联网档案馆使用的爬虫。

除了新闻媒体外,像是 Reddit 这种网络论坛也同样禁止互联网档案馆抓取内容,Reddit 已经与Google和 OpenAI 等签署授权协议,允许这些公司抓取数据并用于训练人工智能模型,至少对 Reddit 来说,如果允许互联网档案馆抓取数据,AI 公司再抓取互联网档案馆的数据,那就可能导致自己没法继续卖数据。

问题在于很多内容并非永久存在,网站时光机的意义在于可以查看网页内容的变动,以及在网页被删除时继续通过快照浏览内容,这对不少用户来说是非常重要的。

因此在 AI 热潮下,新闻媒体屏蔽互联网档案馆抓取数据实际上也是对互联网档案馆和用户的误杀:为了屏蔽 AI 公司进而屏蔽正常使用相关功能的用户。

今日美国称这不是针对互联网档案馆:

今日美国公司发言人表示,屏蔽互联网档案馆抓取内容也并非专门针对互联网档案馆,这是该公司广泛屏蔽所有网络爬虫的正常计划。

卫报商业事务和授权总监则表示,该公司正在与互联网档案馆沟通,就人工智能公司可能滥用为保存目的而抓取内容问题进行讨论 (但还没有明确结果)。

从这种情况来看未来可能会有越来越多的媒体屏蔽互联网档案馆,避免自己的内容被 AI 公司通过互联网档案馆抓取,说到底根源还是这些 AI 公司。

这些 AI 公司未经授权抓取内容、高频次抓取内容等行为屡见不鲜,最终这可能会改变开放互联网的格局,让更多网站从公开访问转向注册登录访问甚至付费访问。